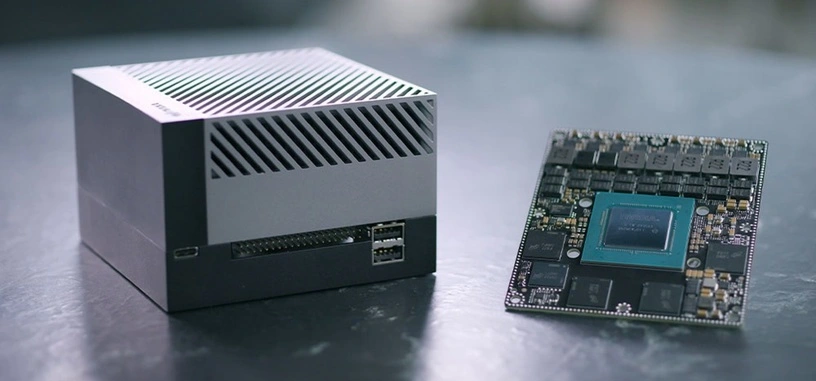

NVIDIA expandiendo sus soluciones para inteligencia artificial, incluidas aquellas que van a proyectos de robots y otros sistemas industriales con la nueva tarjeta Jetson AGX Orin. No es la primera vez que la compañía la menciona pero ha sido ahora cuando ha dado todos los detalles de la misma. Y junto a esta nueva tarjeta hay un nuevo kit de desarrollo para facilitar su puesta en marcha en nuevos proyectos. Hay publicado un documento técnico sobre la plataforma.

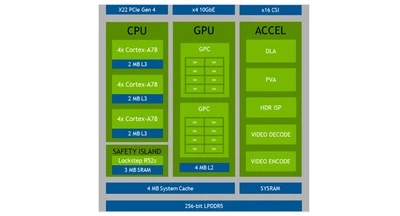

El módulo Jetson AGX Orin es una tarjeta de 100 mm × 87 mm con el sistema en chip de NVIDIA el cual incluye una parte de CPU de 12 núcleos y una parte de GPU de 2048 núcleos CUDA. Tiene un conector Mezzanine de 699 pines como el de las tarjetas anteriores. La parte de unidad de procesamiento está compuesta de tres clústeres de cuatro núcleos Cortex-A78E que funciona hasta 2 GHz. Cada clúster tiene acceso a 2 MB de caché de nivel 3, y cada núcleo tiene 128 KB de caché de nivel 1 y 256 KB de caché de nivel 2. La CPU comparte una caché de sistema de 4 MB. El chip en sí tiene modos de funcionamiento de 15 W, 30 W y 50 W.

La parte de GPU es de diseño Ampère y funciona hasta a 1000 MHz. Está dividida en dos clústeres de procesamiento gráfico (GPC), cada uno de los cuales está subdividido en cuatro clústeres de procesamiento de texturas (TPC) y a su vez en dos multiprocesadores de flujos de datos (SM) cada uno con 128 núcleos CUDA y cuatro núcleos tensoriales de tercera generación. Por tanto, esos dieciséis SM aportan el total de 2048 núcleos CUDA y 64 núcleos tensoriales. Como en otros productos actuales, pueden calcular matrices dispersas lo cual hasta duplica en la práctica la potencia de cómputo de la GPU. La potencia de cómputo en FP32 con los CUDA es de 4 TFLOPS y de hasta 131 TOPS en INT8 disperso mediante los núcleos tensoriales.

Además de lo anterior, esta Jetson AGX Orin incluye dos aceleradores de aprendizaje profundo (DLA) de nueva generación, NVDLA 2.0. Son básicamente unidades para cálculo de operaciones de enteros de 8 bits (INT8), alcanzando los 97 TOPS en INT8 disperso. Esta unidad dispone de 1 MB de búfer propio y está compuesta por dos núcleos de convolución con 608 KB de búfer propio. Se usa para redes neuronales convolucionales usadas para emular la visión humana (visión artificial). Otra parte importante para la visión es la segunda versión del motor de aceleración de visión (PVA 2.0) incluido capaz de procesador siete palabras de instrucción muy largas (VLIW). Se encargará dar compatibilidad con núcleos de sistemas operativos orientados a visión computerizada.

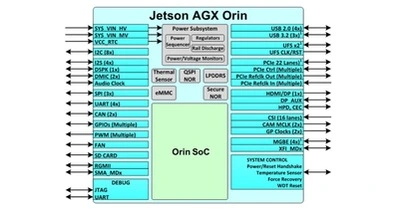

También se incluyen unidades codificadoras de vídeo, decodificadoras y de procesamiento de JPGEG compatibles con H.265, H.264, AV1, VP9, etc. El apartado de la memoria está cubierto por 32 GB de memoria LPDDR5 a 6400 Gb/s (3200 MHz) con un bus de 256 bits e incluye 64 GB de almacenamiento eMMC para un ancho de banda máximo de 204.8 GB/s.

En cuanto a las capacidades de entrada y salida (E/S) proporcionadas por el kit de desarrollo, esta tarjeta puede mover hasta seis cámaras mediante CSI (interfaz serie para cámaras), puede codificar dos señales a 4K y 60 f/s, cuatro a 4K y 30 f/s o hasta 16 FHD a 30 f/s en H.265, y decodificar una señale 8K a 30 f/s o así hasta 24 FHD y 30 f/s en H.265. La tarjeta tiene tres USB 3.0, cuatro USB 2.0, una conexión GigabitEthernet, cuatro 10 GbE y tiene varios conectores extra habituales de tarjetas de desarrollo como UART, SPI, etc.

Estará disponible en el primer trimestre de 2022. Como es habitual, se acompaña de la pila de software CUDA-X desarrollada a medida por NVIDIA y compatible con los sistemas habituales de inteligencia artificial y cálculo de tensores, como TensorFlow, etc. También existirá una versión reducida, Jetson Orin NX, para sistemas embebidos, el cual reduce su memoria a 12 GB y tiene una interfaz externa a 102 GB/s.

Fuente: NVIDIA.