NVIDIA está totalmente volcada en la producción y evolución de sus aceleradoras, más rentables en entrenamiento que en inferencia, y lo demuestra que el 90 % de sus ingresos procede de ellas. Las GeForce, apenas el 5 %. Pero la compañía tiene competidores cercanos, entre ellos AMD, ahora que el sector está rotando hacia inferencia, y por ello necesita dejar claros sus próximos lanzamientos, lo cual no es habitual en la compañía, y menos poniendo ventanas temporales a más dos años vista.

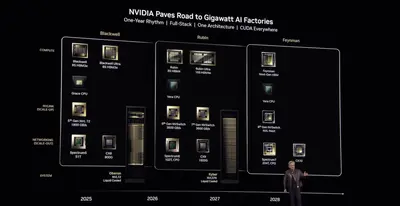

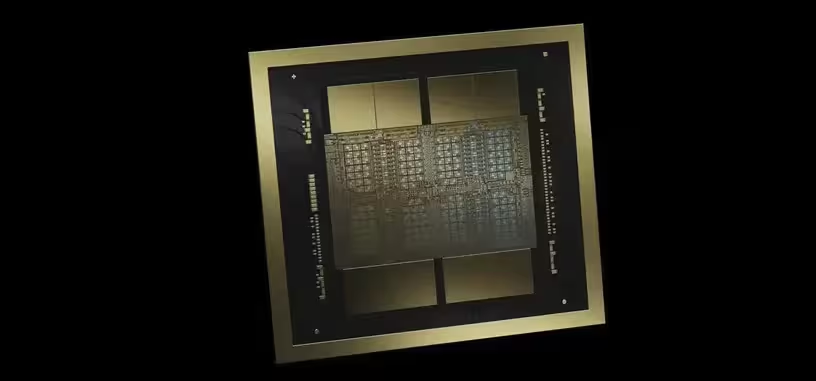

Así que la compañía ha indicado en la GTC que lanzará la arquitectura Rubin en 2026, seguida en la segunda mitad de 2027 por la Rubin Ultra. Este chip, que en realidad serán dos Rubin fusionados, será compatible con los actuales servidores para los chips Blackwell, con una potencia de hasta 100 PFLOPS en FP4 —que no se suele usar mucho por ahora en IA por la pérdida de precisión que supone—, y con 1 TB de HBM4e. Eso para entrenamiento es excepcional, el terreno que domina NVIDIA, pero para inferencia no aporta nada más que un chip supercaro porque no se necesita tanta VRAM.

El chip Rubin es más comedido, con 50 PFLOPS en FP4 denso y 288 GB de HBM4, será lo que llegue el próximo año, y que es la base del Rubin Ultra. Este último lo que aportará será la mejora del ancho de banda por la HBM4e y dos chips Rubin en uno para ahorrar espacio en los servidores de los centros de datos. El chip Rubin Ultra será sucedido por el de arquitectura Feynman, que llegará en 2028, así que NVIDIA ha establecido su itinerario para los tres próximos años.

En cuanto a otros chips anunciados está el Vera, una CPU de 88 núcleos personalizados ARM con multihilo simultáneo, lo cual es raro de ver en el sector ARM por motivos de seguridad y de consumo. Vera Rubin es uno de los «superchips» de los que habla la compañía, el cual combina un procesador Vera con una aceleradora Rubin para ofrecerlo como pequeñas supercomputadoras. Llegará en la segunda mitad de 2026.

Vera Rubin alcanza los 3.6 EFLOPS en inferencia en FP4, 1.2 EFLOPS en entrenamiento FP8, y ahí se ve cómo NVIDIA vuelve a intentar engañar mezclando FP4 y FP8, dando la idea de que en inferencia son mejores que en entrenamiento. Como he dicho antes, FP4 puede tener sentido en inferencia, pero se pierde mucha precisión como para que sea útil. Hay técnicas para mejorar la precisión en FP4, pero no es un tipo de cálculo que sea muy usado en IA ahora mismo, aunque esté creciendo su uso por las ventajas que tiene —menor uso de memoria, mayor rendimiento por vatio—. El mercado principal es el de la visión computerizada, ejecución de grandes modelos de lenguaje en sistemas embebidos. Le queda un poco para que la potencia en FP4 sea un parámetro útil.